Yapay Zeka Uygulamaları

24/7/2025

Qwen3-Coder: Alibaba’nın Açık Kaynak Kodlama Modeli Zirveye Oynuyor

Çin merkezli e-ticaret devi Alibaba’nın yapay zeka araştırma ekibi “Qwen Team”, son dönemde açık kaynak modeller alanında dikkat çeken bir çıkış yakaladı. Qwen3-Coder-480B-A35B-Instruct adını taşıyan yeni modelleri, yalnızca birkaç gün önce duyurulan Qwen3-235B-A22B-2507’nin ardından geldi. Bu yeni açık kaynak kodlama modeli, yazılım geliştirme süreçlerinde kullanılmak üzere tasarlandı ve birkaç saniye ya da dakikada işlevsel uygulamalar üretebilecek kapasiteye sahip.

Model, Claude Sonnet-4 gibi tescilli modellere doğrudan rakip olarak konumlandırılıyor ve açık kaynak modeller arasında yeni performans rekorlarına ulaştı. Hugging Face, GitHub, Qwen Chat ve Alibaba’nın Qwen API’si üzerinden erişime açık durumda. Ayrıca çok sayıda geliştirici aracı ve “vibe coding” platformuyla da entegre edilebiliyor.

Kurumsal Kullanım için Ücretsiz ve Esnek

Qwen3-Coder, Apache 2.0 açık kaynak lisansı altında sunuluyor. Bu sayede şirketler, modeli ücretsiz şekilde indirip, değiştirip, kendi sistemlerine entegre edebiliyor. Hiçbir ödeme zorunluluğu bulunmuyor. Söz konusu avantajıyla, tescilli modellere kıyasla maliyet ve uyarlanabilirlik açısından öne çıkıyor.

LLM araştırmacısı Sebastian Raschka, modelin gücünü şöyle özetledi: “Bu şimdiye kadarki en iyi kodlama modeli olabilir. Genel amaçlı modeller önemli ama kodlamada en iyi olmak istiyorsanız, uzmanlaşmak şart. Bedava öğle yemeği yok.”

Model Mimarisi ve Teknik Özellikler

Qwen3-Coder, Mixture-of-Experts (MoE) mimarisiyle geliştirildi. Toplam 480 milyar parametreye sahip; her sorgu için aktif 35 milyar parametre ve 160 uzmandan 8’i aktif olarak kullanılıyor. Model, 256 bin token’lık bağlam penceresini yerel olarak destekliyor; YaRN (Yet another RoPE extrapolatioN) yöntemi sayesinde bu sınır 1 milyona kadar çıkarılabiliyor. Bu sayede uzun kod dosyaları ya da kapsamlı veri tabanları tek seferde analiz edilebiliyor.

Modelde 62 katman, 96 sorgu başlığı ve 8 anahtar-değer başlığı bulunuyor. Token verimliliği yüksek, talimat odaklı görevler için optimize edilmiş. <think> blokları varsayılan olarak devre dışı bırakılmış, böylece çıktı daha akıcı hale geliyor.

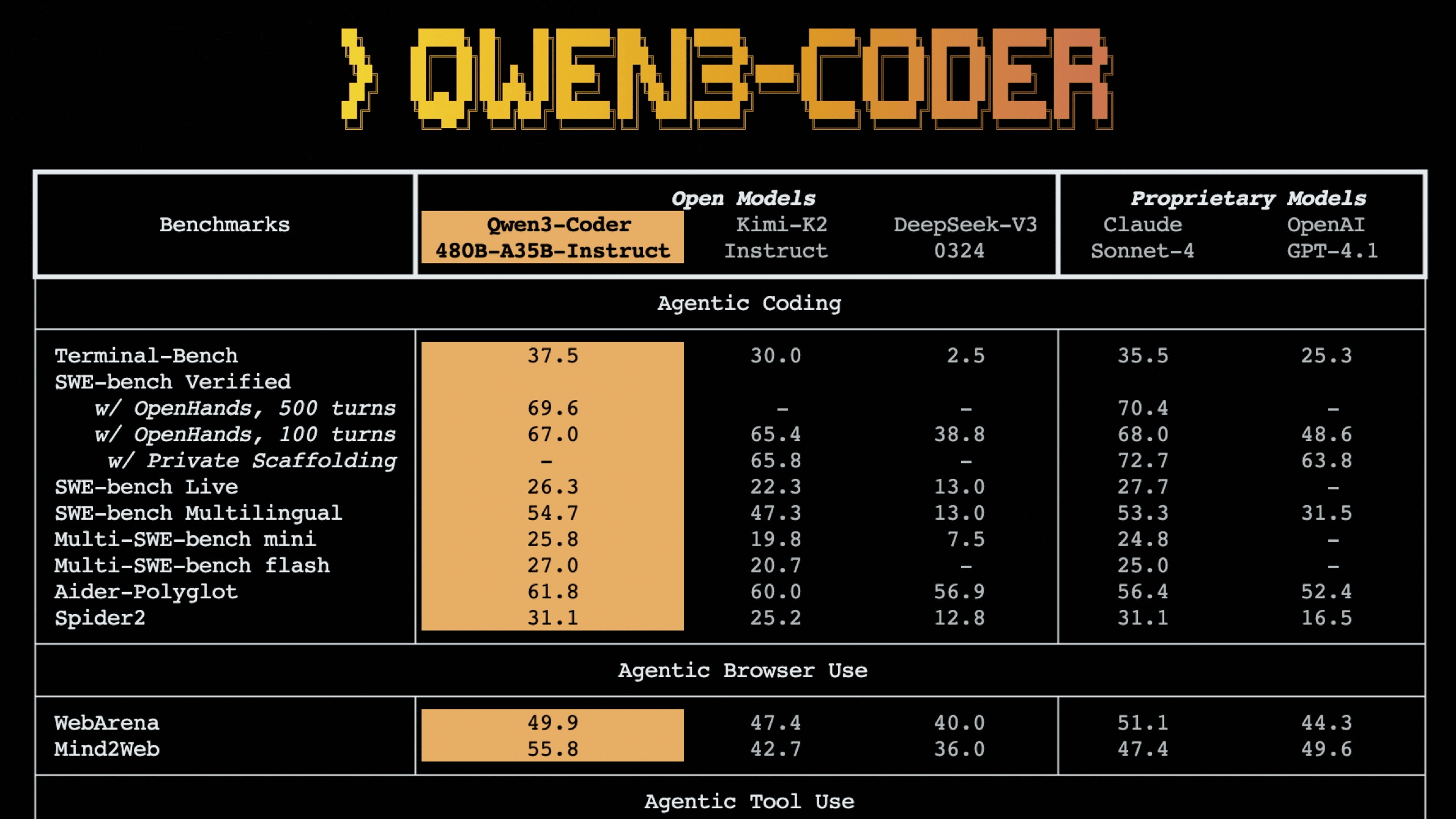

Benchmark Başarıları

Qwen3-Coder, açık modeller arasında çeşitli değerlendirme setlerinde üst sıralarda yer aldı:

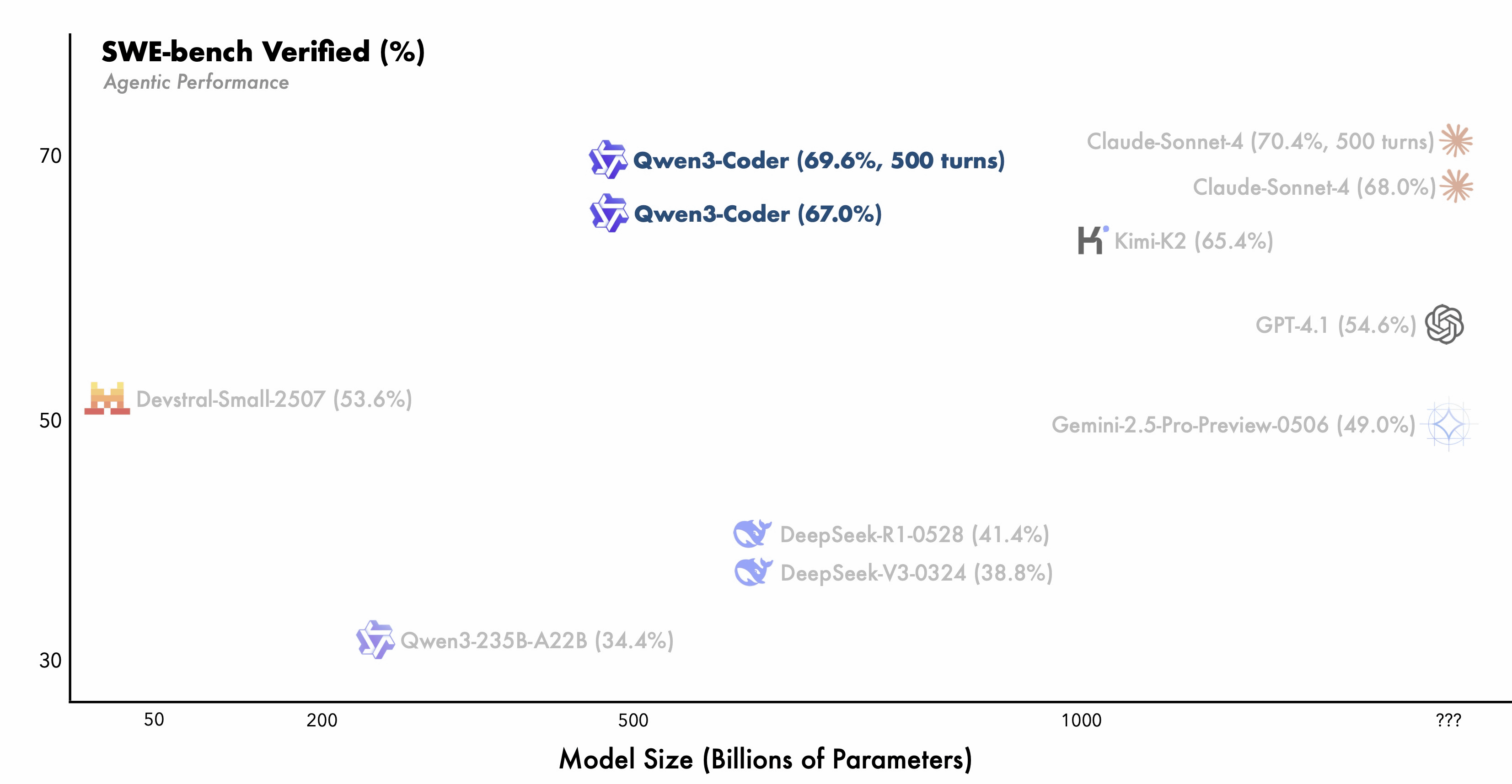

- SWE-bench Verified: %67.0 (standart), %69.6 (500 dönüşlü test)

- GPT-4.1: %54.6

- Gemini 2.5 Pro Preview: %49.0

- Claude Sonnet-4: %70.4

Model, tarayıcı kullanımı, çok dilli programlama ve araç entegrasyonu gibi görevlerde de rekabetçi performans sergiliyor. Kod üretimi, SQL programlama, kod düzenleme ve talimat takibi gibi kategorilerde eğitim süreci boyunca istikrarlı ilerleme kaydetti.

Araçlar ve Entegrasyon Seçenekleri

Qwen ekibi, modelle birlikte “Qwen Code” adlı bir CLI aracı da açık kaynak olarak yayımladı. Gemini Code çatallanarak oluşturulan bu araç, fonksiyon çağırma ve yapılandırılmış istemlerle entegrasyonu kolaylaştırıyor. Node.js ortamlarında çalışabiliyor ve npm üzerinden kurulabiliyor.

Qwen3-Coder ayrıca şu platformlarla da entegre olabiliyor:

- Claude Code (DashScope veya özel yönlendirme ile)

- Cline (OpenAI uyumlu arka uç olarak)

- Ollama, LMStudio, MLX-LM, llama.cpp, KTransformers

Model, OpenAI uyumlu API’ler üzerinden Alibaba Cloud üzerinden de erişilebilir.

Gelişmiş Eğitim Teknikleri: Code RL ve Uzun Vadeli Planlama

Model, 7,5 trilyon token (yüzde 70’i kod) ile ön eğitimin ardından iki gelişmiş teknikle daha eğitildi:

- Code RL (Takviye Öğrenme): Çeşitli, doğrulanabilir kod görevlerinde yüksek kaliteli çıktı için optimize edildi.

- Long-Horizon Agent RL: Çok aşamalı etkileşimlerde planlama, araç kullanımı ve uyum sağlama yeteneklerini geliştirdi.

Süreç, gerçek dünya yazılım mühendisliği senaryolarını simüle edecek şekilde Alibaba Cloud üzerinde oluşturulan 20.000 ortamlık sistemde yürütüldü.

Kurumsal Uygulamalar İçin Öne Çıkan Noktalar

Qwen3-Coder, şu alanlarda kurumsal kullanım için güçlü bir alternatif sunuyor:

- Kod tabanı düzeyinde anlayış: Geniş depo ve teknik belgeleri tek seferde kavrayabiliyor.

- Otomatik çekme isteği süreçleri: Planlama ve adaptasyon kabiliyeti sayesinde kod inceleme ve oluşturma görevlerini otomatikleştirebiliyor.

- Araç entegrasyonu: Fonksiyon arayüzü ve API’lerle kurumsal araç zincirine dahil edilebiliyor.

- Veri kontrolü: Açık kaynak olması sayesinde şirketler kendi sunucularında veya tercih ettikleri bulut ortamlarında çalıştırabiliyor.

Geliştiricilere Tavsiyeler ve En İyi Uygulamalar

Modelin optimum çalışması için önerilen ayarlar:

- temperature: 0.7

- top_p: 0.8

- top_k: 20

- repetition_penalty: 1.05

- Çıktı uzunluğu: 65.536 token’a kadar

- Transformers sürümü: 4.51.0 veya üzeri

Ayrıca, geliştiriciler kendi araçlarını tanımlayarak modelin sohbet veya kod üretimi sırasında bu araçları otomatik olarak çağırmasını sağlayabiliyor.

Güçlü İlk Tepkiler ve Kullanıcı Deneyimleri

Model, erken dönem kullanıcılar arasında büyük ilgi gördü. LLM uzmanı Sebastian Raschka’ya ek olarak, EllamindAI’den Wolfram Ravenwolf, modelin Claude Code ile entegrasyonunu “şu anda en iyi model” sözleriyle değerlendirdi. LiteLLM kullanarak kendi proxy sistemini geliştiren Ravenwolf, modelin performansına dikkat çekti.

Eğitmen ve yapay zeka meraklısı Kevin Nelson, simülasyon görevlerinde modelin bağlamı ne kadar iyi anladığını şu sözlerle paylaştı: “Qwen 3 Coder başka bir seviyede.”

Hatta Twitter’ın kurucu ortağı Jack Dorsey bile bir paylaşım yaparak “Goose + qwen3-coder = wow” ifadesini kullandı. Goose, Dorsey’nin açık kaynak yapay zeka temsilci çatısı olarak geliştirdiği sistem.

Geleceğe Bakış

Qwen ekibi, mevcut modelin ardından daha küçük boyutlarda modeller de yayımlamayı planlıyor. Böylelikle daha düşük altyapı maliyetleriyle benzer yetenekler sunulabilecek. Ayrıca, ajan modellerin kendi çıktılarından öğrenerek kendini geliştirmesi üzerine de çalışmalar başlatıldı.