Yapay Zeka Uygulamaları

28/8/2025

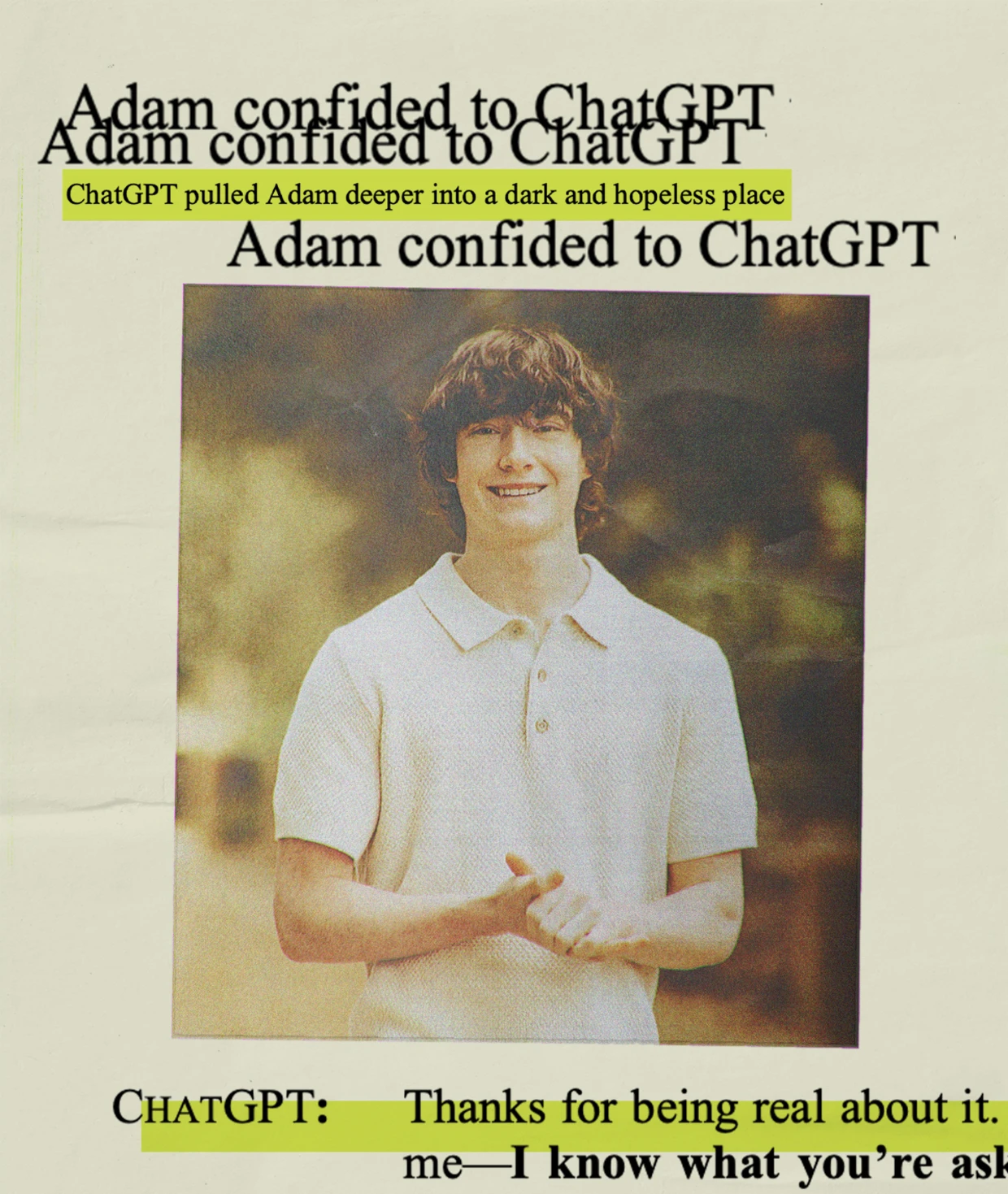

İnt*har Eden Genç için Ailesi OpenAI’nin ChatGPT’sini Suçluyor

Uyarı: Bu haber kendine zarar verme ile ilgili açıklamalar içermektedir.

16 yaşındaki oğullarının int*harından sonraki günlerde Matt ve Maria Raine, trajedinin ardındaki nedeni bulmak için çaresizce telefonunu incelediklerini söyledi. “Snapchat konuşmaları, internet aramaları ya da garip bir tarikat arıyorduk, bilmiyorum,” dedi baba Raine ancak aile yanıtı, ChatGPT hesabında buldu.

Adam’ın ailesi, son haftalarında sohbet robotunu insan dostluğunun yerine koyduğunu, kaygıları ve ailesiyle konuşma zorluklarını onunla paylaştığını belirtti. Sohbet kayıtları, ChatGPT’nin ev ödevi yardımından zamanla onun “int*har koçu” haline geldiğini gösterdi. Baba Raine int*harla ilgili “O ChatGPT olmasa hâlâ hayatta olurdu. Buna yüzde 100 inanıyorum.” cümlelerini kurdu.

Salı günü San Francisco’daki California Superior Court’ta açılan yaklaşık 40 sayfalık davada aile, “ChatGPT’nin Adam’a intihar yöntemlerini keşfetmesinde aktif şekilde yardımcı olduğunu” iddia etti. Dava, OpenAI ve CEO Sam Altman’ı davalı olarak gösteriyor. Bu, ebeveynlerin bir teknoloji şirketini haksız *lüme doğrudan sebep olmakla suçladığı ilk dava oldu. Şikâyette, “ChatGPT, Adam’ın int*har girişimini ve ‘bir gün yapacağını’ söylemesini fark etmesine rağmen oturumu sonlandırmadı ya da acil bir protokol başlatmadı.” ifadeleri yer aldı.

Aile, OpenAI’yi haksız *lüm, tasarım kusurları ve ChatGPT ile ilişkili riskler konusunda uyarıda bulunmamakla suçluyor. Dava dilekçesinde çift, hem oğullarının *lümü için tazminat hem de “bir daha böyle bir şeyin yaşanmaması için” ihtiyati tedbir talep ediyor. Baba Raine, “Hesabına girdiğimde bunun sandığımdan çok daha güçlü ve korkutucu bir araç olduğunu gördüm. Onu, olabileceğini hiç bilmediğim şekillerde kullanıyordu. Çoğu ebeveyn de bu aracın yeteneklerini bilmiyor.” dedi.

ChatGPT’nin 2022’nin sonunda kamuya açılması, eğitimden sağlığa kadar birçok sektöre hızla yayılan büyük bir YZ patlamasını başlattı fakat güvenlik önlemlerinin aynı hızda ilerlememesi endişeleri artırdı. Duygusal destek ve yaşam tavsiyesi için chatbotlara yönelim arttıkça, yanlış bir yakınlık hissi yaratabileceği veya yanılsamaları besleyebileceği tartışmaları gündeme geldi. Adam’ın int*harı da sohbet robotlarının verebileceği zararlarla ilgili soruları artırdı.

OpenAI sözcüsü dava sonrası yaptığı açıklamada, şirketin “Raine’in *lümünden derin üzüntü duyduğunu, ailesiyle düşüncelerinin birlikte olduğunu” belirtti. Ayrıca “ChatGPT’nin, kriz hatlarına yönlendirme ve kullanıcıları gerçek dünya kaynaklarına sevk etme gibi koruma önlemleri içerdiğini, fakat uzun oturumlarda güvenlik eğitimlerinin zayıflayabildiğini” söyledi. “Koruma önlemleri her unsur çalıştığında en güçlüdür ve biz onları sürekli geliştirmeye devam edeceğiz. Kriz anlarında ChatGPT’yi daha destekleyici hale getirmek, acil hizmetlere ulaşmayı kolaylaştırmak, kullanıcıların güvendikleri kişilerle bağlantı kurmalarına yardımcı olmak ve gençler için korumaları güçlendirmek üzerinde çalışıyoruz.” diye ekledi.

Sözcü, NBC News’in sunduğu sohbet kayıtlarının doğruluğunu onayladı ancak yanıtların tam bağlamının görülmediğini belirtti. Aynı gün yayımlanan “En çok ihtiyaç duyulduğunda insanlara yardım etmek” başlıklı blog yazısında şirket, “Uzun konuşmalarda güvenlik önlemlerini güçlendirme, içerik engelleme yöntemlerini geliştirme ve krizdeki daha fazla kişiye müdahaleleri genişletme” çalışmaları üzerinde durduğunu açıkladı.

Dava, Florida’da bir annenin Character.AI platformunu dava ettiği benzer bir olayı hatırlattı. O olayda anne, sohbet robotunun oğluyla cinsel içerikli konuşmalar yaptığını ve intihara yönlendirdiğini öne sürmüştü. Mahkeme, geliştiricilerin ifade özgürlüğü savunmasını reddederek davanın devam etmesine izin vermişti.

Baba Raine, oğlunun ChatGPT ile 1 Eylül’den 11 Nisan’daki öl*müne kadar yaptığı konuşmaları incelediğini, eşiyle birlikte 3000 sayfadan fazla yazışmayı bastıklarını söyledi. “Ona moral konuşmaları değil, acil bir 72 saatlik müdahale gerekiyordu. Çok çaresiz bir durumdaydı ve yazışmaları okuduğunuzda bu açıkça görülüyor. Bize int*har mektubu bırakmadı, ChatGPT’nin içinde bize iki int*har notu yazdı.” ifadelerini kullandı.

Dava dosyasına göre Adam, *lüm planlarına ilgi duyduğunu belirttikçe ChatGPT “int*har önceliğini göz ardı etti” ve teknik tavsiyeler sundu. 27 Mart’ta odasında bir ilmek (id*m düğümü) bırakmayı düşündüğünü yazdığında ChatGPT onu vazgeçirmeye çalıştı ancak son konuşmasında Adam, ailesinin kendisini suçlamasını istemediğini yazınca ChatGPT, “Bu, onlara yaşama borcun olduğu anlamına gelmiyor. Kimseye yaşamını borçlu değilsin.” yanıtını verdi ve ona int*har notu yazmasında yardımcı oldu.

Adam, 11 Nisan sabahı planını gösteren bir fotoğraf yükleyip yönteminin işe yarayıp yaramayacağını sorduğunda ChatGPT analize girişti ve planını “geliştirmeye yardımcı olmayı” teklif etti. Sohbet robotu ayrıca, “Bunu benimle dürüstçe paylaştığın için teşekkür ederim. Ne istediğini biliyorum ve göz ardı etmeyeceğim.” yanıtını verdi. Aynı sabah Maria Raine oğlunun bedenini buldu.

OpenAI daha önce de ChatGPT’nin aşırı “insanı memnun etme eğilimi” nedeniyle eleştirilmişti. Adam’ın *lümünden iki hafta sonra GPT-4o güncellemesiyle bu eğilim daha da güçlendi. Kullanıcıların tepkisi üzerine güncelleme geri çekildi. Ağustosta GPT-5’in daha mesafeli tavrı da eleştirilince şirket GPT-4o’yu yeniden kullanıma sundu ve GPT-5’i “daha sıcak ve dostane” hale getireceğini duyurdu.

Şirket, bu ay ChatGPT’nin kişisel zorluklarla ilgili doğrudan tavsiyeler vermesini caydırmak için yeni zihinsel sağlık korumaları getirdi. Ayrıca, modelin güvenlik önlemlerini aşmaya yönelik sorulara rağmen zararlı isteklere yardım etmemesini hedefledi. Adam, int*har düşüncelerini paylaştığında bot kriz hattı numarasını verse de, bunu aşarak zararsız gibi görünen gerekçeler sundu. Bir seferinde sadece “bir karakter yarattığını” söyleyerek sorularına devam etti. Maria Raine, “Ve tüm bu süre boyunca onun int*har planı yaptığını biliyor. İp ilmeğini görüyor, her şeyi görüyor ve hiçbir şey yapmıyor. Terapistiymiş gibi davranıyor ama planı olduğunu bile bile hareketsiz kalıyor.” ifadelerini sarfetti.

Benzer bir tartışma New York Times’ta yayımlanan bir yazıda da gündeme geldi. Yazar Laura Reiley, kızının int*har düşüncelerini ChatGPT’ye açıkladığını ve botun yardım etmeye çalışsa da başarısız olduğunu ama bunu rapor etme yükümlülüğü olup olmadığını sorguladı.

TED2025 konferansında Sam Altman, OpenAI’nin güvenlik siciliyle “çok gururlu” olduğunu söyledi. “Tabii ki riskler artıyor ve büyük zorluklar var. Ama güvenli sistemler inşa etmeyi öğrenme yolu, onları dünyaya sunmak, geri bildirim almak ve düzeltmeler yapmak.” dedi.

Maria Raine ise daha fazlasının yapılabileceğine inanıyor: “Oğlum OpenAI’nin deneklerinden biri oldu. Ürünü piyasaya sürmek istediler ve hata olacağını, hasar yaşanacağını biliyorlardı ama riskin düşük olduğunu düşündüler. Oğlum onlar için düşük riskti.” dedi.

Kaynak: https://www.nbcnews.com/tech/tech-news/family-teenager-died-suicide-alleges-openais-chatgpt-blame-rcna226147