Yapay Zeka Uygulamaları

1/9/2025

Anthropic, Yapay Zeka Modellerini Sohbet Kayıtlarıyla Eğitmeye Başlayacak

Anthropic, kullanıcı verilerini, yeni sohbet kayıtları ve kodlama oturumları dahil, yapay zeka modellerini eğitmek için kullanmaya başlayacak ama kullanıcılar istemezse bu uygulamadan vazgeçme (opt-out) seçeneğine sahip olacak. Şirket ayrıca veri saklama politikasını da beş yıla uzatıyor. Kullanıcılar tercihlerini 28 Eylül 2025 tarihine kadar bildirmek zorunda.

Anthropic’in perşembe günü yayımladığı blog yazısına göre, “Accept” (kabul et) seçeneğine tıklayan kullanıcıların verileri anında eğitim sürecine dahil edilecek ve en fazla beş yıl boyunca saklanacak. Bu ayar yalnızca “yeni veya yeniden başlatılan sohbetler ve kodlama oturumları” için geçerli olacak. Daha önce başlatılmış ancak devam ettirilmemiş sohbet ve oturumlar eğitim için kullanılmayacak. Fakat kullanıcı eski bir sohbeti ya da kodlama oturumunu devam ettirirse veriler işlenebilecek.

Güncellemeler, Claude Free, Pro ve Max dahil olmak üzere tüm bireysel abonelik katmanlarını kapsıyor. Anthropic, “Bu ayarlar, söz konusu planlarla ilişkili hesaplarda Claude Code kullanıldığında da geçerlidir.” dedi. Ancak bu değişiklikler, Claude Gov, Claude for Work, Claude for Education veya üçüncü taraf platformlar aracılığıyla kullanılan API için uygulanmayacak. Amazon Bedrock ya da Google Cloud Vertex AI gibi hizmetler bu kapsamın dışında bırakıldı.

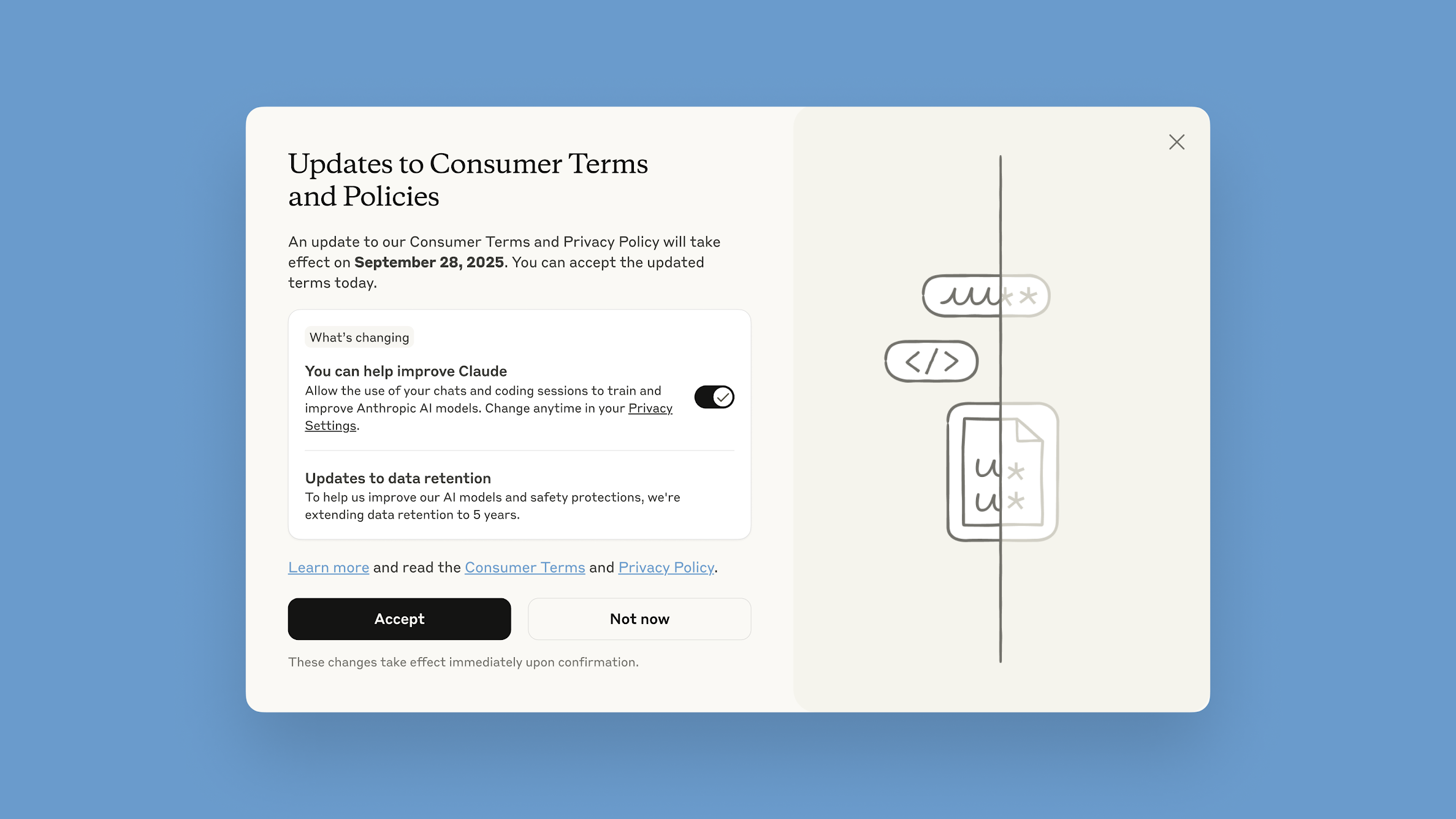

Yeni kullanıcılar, tercihlerini Claude kayıt süreci sırasında belirleyecek. Mevcut kullanıcılar ise karşılarına çıkan bir pop-up üzerinden seçim yapacak. Kullanıcılar “Not now” butonuna basarak kararı erteleyebilecek ancak 28 Eylül’e kadar mutlaka bir seçim yapmak zorunda kalacaklar.

Kullanıcıların birçoğunun dikkatlice okumadan hızlıca “Accept” butonuna basma ihtimali bulunuyor. Pop-up ekranında büyük harflerle “Updates to Consumer Terms and Policies” yazıyor ve altında “28 Eylül 2025’te yürürlüğe girecek güncellemeler için şartlarımız ve gizlilik politikamız değişiyor. Bugün kabul edebilirsiniz” (An update to our Consumer Terms and Privacy Policy will take effect on September 28, 2025. You can accept the updated terms today) ifadeleri yer alıyor. Alt kısımda büyük siyah bir “Accept” butonu bulunuyor.

Daha küçük puntolarla yazılmış birkaç satırda ise “Sohbetlerinizin ve kodlama oturumlarınızın Anthropic yapay zeka modellerinin eğitimi ve geliştirilmesi için kullanılmasına izin verin” ifadesi var. Yanında On / Off (Açık/Kapalı) şeklinde bir geçiş düğmesi bulunuyor ve bu düğme varsayılan olarak “Açık” konumda geliyor. Çoğu kullanıcı, bu ayarı fark etmeden doğrudan “Accept” butonuna basabilir.

Vazgeçmek isteyen kullanıcılar pop-up ekranında geçiş düğmesini “Kapalı” konumuna getirebilir. Eğer kullanıcı daha önce “Accept” seçeneğine tıkladıysa, sonradan Settings > Privacy > Privacy Settings > Help improve Claude bölümüne giderek buradaki düğmeyi “Kapalı” konumuna alabilir. Karar, her zaman değiştirilebilir. Ancak yeni karar yalnızca gelecekteki veriler için geçerli olacak; sistemin daha önce eğitildiği veriler geri alınamayacak.

Anthropic blog yazısında şu ifadeleri kullandı: “Kullanıcıların gizliliğini korumak için araçlar ve otomatik süreçlerin birleşimini kullanarak hassas verileri filtreliyor veya belirsizleştiriyoruz. Kullanıcıların verilerini üçüncü taraflara satmıyoruz.”

Kaynak: https://www.theverge.com/anthropic/767507/anthropic-user-data-consumers-ai-models-training-privacy